Hadoop家族系列文章,主要介绍Hadoop家族产品,常用的项目包括Hadoop, Hive, Pig, HBase, Sqoop, Mahout, Zookeeper, Avro, Ambari, Chukwa,新增加的项目包括,YARN, Hcatalog, Oozie, Cassandra, Hama, Whirr, Flume, Bigtop, Crunch, Hue等。

从2011年开始,中国进入大数据风起云涌的时代,以Hadoop为代表的家族软件,占据了大数据处理的广阔地盘。开源界及厂商,所有数据软件,无一不向Hadoop靠拢。Hadoop也从小众的高富帅领域,变成了大数据开发的标准。在Hadoop原有技术基础之上,出现了Hadoop家族产品,通过“大数据”概念不断创新,推出科技进步。

作为IT界的开发人员,我们也要跟上节奏,抓住机遇,跟着Hadoop一起雄起!

关于作者:

- 张丹(Conan), 程序员Java,R,PHP,Javascript

- weibo:@Conan_Z

- blog: http://blog.fens.me

- email: bsspirit@gmail.com

转载请注明出处:

http://blog.fens.me/hadoop-history-source-install/

前言

介绍Hadoop安装的文章,已经写过2篇了,老生常谈的话题又被拿出来了。这次要重新安装Hadoop-1.1.2的历史版本,来满足Mahout-0.8版本的依赖要求。本来只想简单说几句,不过遇到了几个小问题,因此写篇文章总结一下吧。

Hadoop安装的其他文章:

- RHadoop实践系列之一 Hadoop环境搭建

- 创建Hadoop母体虚拟机

目录

- 找到Hadoop历史版本

- 用源代码构建Hadoop环境

- 快速Hadoop配置环境脚本

- 为win环境编译hadoop-core.jar

1. 找到Hadoop历史版本

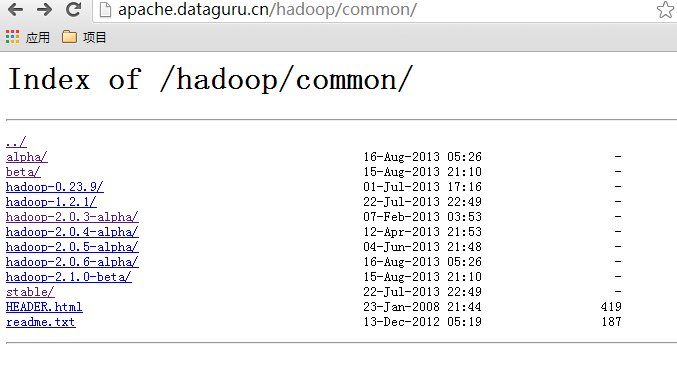

这里我需要的Hadoop版本是1.1.2。打开hadoop的下载页面

<code>http://www.apache.org/dyn/closer.cgi/hadoop/common/</code>

随便打开一个下载镜像,我们都找不到1.1.2这个版本。

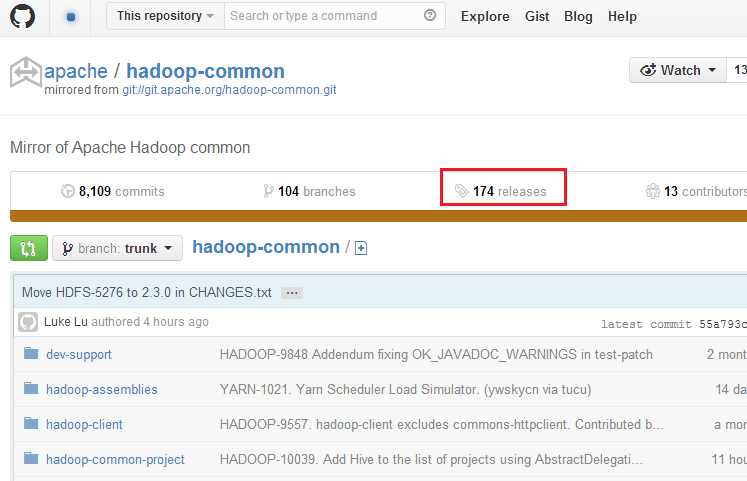

看看github上的情况

找到release-1.1.2

<code>https://github.com/apache/hadoop-common/releases/tag/release-1.1.2</code>

下载源代码:

<code>~ wget https://github.com/apache/hadoop-common/archive/release-1.1.2.tar.gz</code>

查看branch-1.1

<code>https://github.com/apache/hadoop-common/tree/branch-1.1</code>

2. 用源代码构建Hadoop环境

注:github上面最新hadoop-3.0.0-SNAPSHOT,包结构已经完全改变,用Maven代替了Ant+Ivy的构建过程。

Linux系统环境:

- Linux Ubuntu 64bit Server 12.04.2 LTS

- Java 1.6.0_29

- Ant 1.8.4

安装Hadoop

<code></p><p>~ tar xvf release-1.1.2.tar.gz</p><p>~ mkdir /home/conan/hadoop/</p><p>~ mv hadoop-common-release-1.1.2 /home/conan/hadoop/</p><p>~ cd /home/conan/hadoop/</p><p>~ mv hadoop-common-release-1.1.2/ hadoop-1.1.2</p><p></code>

查看hadoop目录

<code></p><p>~ ls -l</p><p>total 648</p><p>drwxrwxr-x 2 conan conan 4096 Mar 6 2013 bin</p><p>-rw-rw-r-- 1 conan conan 120025 Mar 6 2013 build.xml</p><p>-rw-rw-r-- 1 conan conan 467130 Mar 6 2013 CHANGES.txt</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 02:31 conf</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 02:28 ivy</p><p>-rw-rw-r-- 1 conan conan 10525 Mar 6 2013 ivy.xml</p><p>drwxrwxr-x 4 conan conan 4096 Mar 6 2013 lib</p><p>-rw-rw-r-- 1 conan conan 13366 Mar 6 2013 LICENSE.txt</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 03:35 logs</p><p>-rw-rw-r-- 1 conan conan 101 Mar 6 2013 NOTICE.txt</p><p>-rw-rw-r-- 1 conan conan 1366 Mar 6 2013 README.txt</p><p>-rw-rw-r-- 1 conan conan 7815 Mar 6 2013 sample-conf.tgz</p><p>drwxrwxr-x 16 conan conan 4096 Mar 6 2013 src</p><p></code>

在根目录下面,没有hadoop-*.jar的各种类库,也没有依赖库。

执行Ant进行编译

从Ant官方网站下载Ant, http://ant.apache.org/bindownload.cgi

<code></p><p>~ wget http://archive.apache.org/dist/ant/binaries/apache-ant-1.8.4-bin.tar.gz</p><p>~ tar xvf apache-ant-1.8.4-bin.tar.gz</p><p>~ mkdir /home/conan/toolkit/</p><p>~ mv apache-ant-1.8.4 /home/conan/toolkit/</p><p>~ cd /home/conan/toolkit/</p><p>~ mv apache-ant-1.8.4 ant184</p><p></code>

设置ant到环境变量

<code></p><p># 编辑environment文件</p><p>~ sudo vi /etc/environment</p><p>PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/home/conan/toolkit/jdk16/bin:/home/conan/toolkit/ant184/bin"</p><p>JAVA_HOME=/home/conan/toolkit/jdk16</p><p>ANT_HOME=/home/conan/toolkit/ant184</p><p>#让环境变量生效</p><p>~ . /etc/environment</p><p>#运行ant命令,检查环境变量是否配置成功</p><p>~ ant</p><p>Buildfile: build.xml does not exist!</p><p>Build failed</p><p></code>

用Ant编译Hadoop

<code></p><p># 安装编译用的库</p><p>~ sudo apt-get install autoconf</p><p>~ sudo apt-get install libtool</p><p># 用Ant编译Hadoop</p><p>~ cd /home/conan/hadoop/hadoop-1.1.2/</p><p>~ ant</p><p></code>

要等几分钟,然后build成功。

查看生成的build目录

<code></p><p>~ ls -l build</p><p>drwxrwxr-x 3 conan conan 4096 Oct 3 04:06 ant</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 04:02 c++</p><p>drwxrwxr-x 3 conan conan 4096 Oct 3 04:05 classes</p><p>drwxrwxr-x 13 conan conan 4096 Oct 3 04:06 contrib</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 04:05 empty</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 04:02 examples</p><p>-rw-rw-r-- 1 conan conan 423 Oct 3 04:05 hadoop-client-1.1.3-SNAPSHOT.jar</p><p>-rw-rw-r-- 1 conan conan 4035744 Oct 3 04:05 hadoop-core-1.1.3-SNAPSHOT.jar</p><p>-rw-rw-r-- 1 conan conan 426 Oct 3 04:05 hadoop-minicluster-1.1.3-SNAPSHOT.jar</p><p>-rw-rw-r-- 1 conan conan 306827 Oct 3 04:05 hadoop-tools-1.1.3-SNAPSHOT.jar</p><p>drwxrwxr-x 4 conan conan 4096 Oct 3 04:02 ivy</p><p>drwxrwxr-x 3 conan conan 4096 Oct 3 04:02 src</p><p>drwxrwxr-x 6 conan conan 4096 Oct 3 04:02 test</p><p>drwxrwxr-x 3 conan conan 4096 Oct 3 04:05 tools</p><p>drwxrwxr-x 9 conan conan 4096 Oct 3 04:02 webapps</p><p></code>

发现hadoop-*.jar都是hadoop-*-1.1.3-SNAPSHOT.jar结尾的,合理的解释就是:上一个版本的release就是下一个版本的SNAPSHOT。

我们修改一下build.xml文件31行,把包名改成hadoop-*-1.1.2.jar,再重新ant

<code></p><p>~ vi build.xml</p><p>~ rm -rf build</p><p>~ ant</p><p></code>

把生成的hadoop-*-1.1.2.jar复制到根目录

<code></p><p>~ cp build/*.jar .</p><p>~ ls -l</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 04:24 bin</p><p>drwxrwxr-x 13 conan conan 4096 Oct 3 04:21 build</p><p>-rw-rw-r-- 1 conan conan 120016 Oct 3 04:20 build.xml</p><p>-rw-rw-r-- 1 conan conan 467130 Mar 6 2013 CHANGES.txt</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 02:31 conf</p><p>-rw-rw-r-- 1 conan conan 414 Oct 3 04:24 hadoop-client-1.1.2.jar</p><p>-rw-rw-r-- 1 conan conan 4035726 Oct 3 04:24 hadoop-core-1.1.2.jar</p><p>-rw-rw-r-- 1 conan conan 417 Oct 3 04:24 hadoop-minicluster-1.1.2.jar</p><p>-rw-rw-r-- 1 conan conan 306827 Oct 3 04:24 hadoop-tools-1.1.2.jar</p><p>drwxrwxr-x 2 conan conan 4096 Oct 3 02:28 ivy</p><p>-rw-rw-r-- 1 conan conan 10525 Mar 6 2013 ivy.xml</p><p>drwxrwxr-x 4 conan conan 4096 Mar 6 2013 lib</p><p>-rw-rw-r-- 1 conan conan 13366 Mar 6 2013 LICENSE.txt</p><p>drwxrwxr-x 3 conan conan 4096 Oct 3 04:28 logs</p><p>-rw-rw-r-- 1 conan conan 101 Mar 6 2013 NOTICE.txt</p><p>-rw-rw-r-- 1 conan conan 1366 Mar 6 2013 README.txt</p><p>-rw-rw-r-- 1 conan conan 7815 Mar 6 2013 sample-conf.tgz</p><p>drwxrwxr-x 16 conan conan 4096 Mar 6 2013 src</p><p></code>

这个就生成好了,hadoop环境,和我们之前下载的就一样了。

3. 快速Hadoop配置环境脚本

- 1. 配置环境变量

- 2. Hadoop的3个配置文件

- 3. 创建Hadoop目录

- 4. 配置hostname和hosts

- 5. 生成SSH免登陆

- 6. 第一次启动格式化HDFS

- 7. 启动Hadoop的服务

下面的脚本要写在一起

<code></p><p>~ sudo vi /etc/environment</p><p>PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/home/conan/toolkit/jdk16/bin:/home/conan/toolkit/ant184/bin:/home/conan/toolkit/maven3/bin:/home/conan/toolkit/tomcat7/bin:/home/conan/hadoop/hadoop-1.1.2/bin"</p><p>JAVA_HOME=/home/conan/toolkit/jdk16</p><p>ANT_HOME=/home/conan/toolkit/ant184</p><p>MAVEN_HOME=/home/conan/toolkit/maven3</p><p>NUTCH_HOME=/home/conan/toolkit/nutch16</p><p>TOMCAT_HOME=/home/conan/toolkit/tomcat7</p><p>HADOOP_HOME=/home/conan/hadoop/hadoop-1.1.2</p><p>HADOOP_CMD=/home/conan/hadoop/hadoop-1.1.2/bin/hadoop</p><p>HADOOP_STREAMING=/home/conan/hadoop/hadoop-1.1.2/contrib/streaming/hadoop-streaming-1.1.2.jar</p><p>~ . /etc/environment</p><p>~ vi conf/core-site.xml</p><p><configuration></p><p><property></p><p><name>fs.default.name</name></p><p><value>hdfs://master:9000</value></p><p></property></p><p><property></p><p><name>hadoop.tmp.dir</name></p><p><value>/home/conan/hadoop/tmp</value></p><p></property></p><p><property></p><p><name>io.sort.mb</name></p><p><value>256</value></p><p></property></p><p></configuration></p><p>~ vi conf/hdfs-site.xml</p><p><configuration></p><p><property></p><p><name>dfs.data.dir</name></p><p><value>/home/conan/hadoop/data</value></p><p></property></p><p><property></p><p><name>dfs.replication</name></p><p><value>1</value></p><p></property></p><p><property></p><p><name>dfs.permissions</name></p><p><value>false</value></p><p></property></p><p></configuration></p><p>~ vi conf/mapred-site.xml</p><p><configuration></p><p><property></p><p><name>mapred.job.tracker</name></p><p><value>hdfs://master:9001</value></p><p></property></p><p></configuration></p><p>~ mkdir /home/conan/hadoop/data</p><p>~ mkdir /home/conan/hadoop/tmp</p><p>~ sudo chmod 755 /home/conan/hadoop/data/</p><p>~ sudo chmod 755 /home/conan/hadoop/tmp/</p><p>~ sudo hostname master</p><p>~ sudo vi /etc/hosts</p><p>192.168.1.210 master</p><p>127.0.0.1 localhost</p><p>~ ssh-keygen -t rsa</p><p>~ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys</p><p>~ bin/hadoop namenode -format</p><p>~ bin/start-all.sh</p><p></code>

检查hadoop运行状态

<code></p><p>~ jps</p><p>15574 DataNode</p><p>16324 Jps</p><p>15858 SecondaryNameNode</p><p>16241 TaskTracker</p><p>15283 NameNode</p><p>15942 JobTracker</p><p>~ bin/hadoop dfsadmin -report</p><p>Configured Capacity: 18751434752 (17.46 GB)</p><p>Present Capacity: 14577520655 (13.58 GB)</p><p>DFS Remaining: 14577491968 (13.58 GB)</p><p>DFS Used: 28687 (28.01 KB)</p><p>DFS Used%: 0%</p><p>Under replicated blocks: 0</p><p>Blocks with corrupt replicas: 0</p><p>Missing blocks: 0</p><p>-------------------------------------------------</p><p>Datanodes available: 1 (1 total, 0 dead)</p><p>Name: 192.168.1.210:50010</p><p>Decommission Status : Normal</p><p>Configured Capacity: 18751434752 (17.46 GB)</p><p>DFS Used: 28687 (28.01 KB)</p><p>Non DFS Used: 4173914097 (3.89 GB)</p><p>DFS Remaining: 14577491968(13.58 GB)</p><p>DFS Used%: 0%</p><p>DFS Remaining%: 77.74%</p><p>Last contact: Thu Oct 03 05:03:50 CST 2013</p><p></code>

4. 为win环境编译hadoop-core.jar

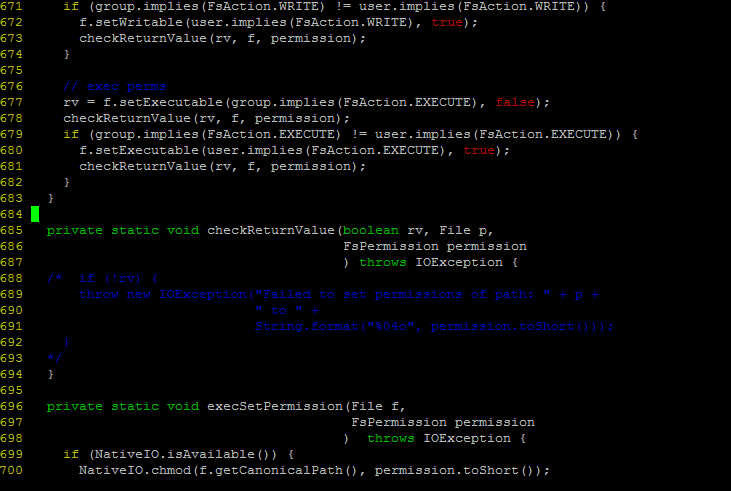

在win环境开发中,经常会遇到一个错误权限检查的异常,我们需要修改FileUtil.java文件,注释688行–693行。

<code></p><p>~ vi src/core/org/apache/hadoop/fs/FileUtil.java</p><p>685 private static void checkReturnValue(boolean rv, File p,</p><p>686 FsPermission permission</p><p>687 ) throws IOException {</p><p>688 /* if (!rv) {</p><p>689 throw new IOException("Failed to set permissions of path: " + p +</p><p>690 " to " +</p><p>691 String.format("%04o", permission.toShort()));</p><p>692 }</p><p>693 */</p><p>694 }</p><p></code>

用ant重新打包后,就生成了可以在win运行的hadoop-core-1.1.2.jar!使用方法可以参考文章:用Maven构建Hadoop项目,我们后面一直会用到!